苹果新专利:可改进Siri以控制包括Vision Pro、iPhone等设备上的应用程序

昨天,美国专利商标局公布了苹果公司的一项专利申请,涉及使Siri能够理解一套新的命令,用于控制文字处理器等应用程序,该发明与Apple Vision Pro、iPhone等设备有关。

苹果的Siri可能需要经过训练才能与应用程序互动,或处理命令以执行一项或多项任务。这可能很麻烦,也很费时间,给希望将其应用程序与数字助理整合的开发者和寻求用数字助理完成不同任务的用户造成障碍。

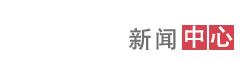

苹果公司希望用其即将推出的Vision Pro空间计算头显解决这个问题。苹果在专利图1B中指出,系统#100包括两个(或多个)通信设备。第一个设备#100b(例如,基站设备)包括处理器(可以是有线或无线的)。第二设备#100c(例如,头戴式设备)包括各种部件,如处理器、射频电路、存储器、图像传感器、方向传感器、麦克风、位置传感器、扬声器、显示器等等。

苹果在专利中用8个段落介绍了AR/VR/MR,以强调与Siri控制应用有关的发明将会延伸到他们即将推出的Vision Pro中。

在苹果的专利图7中,Apple Vision Pro可以产生一个VR环境,包括一个或多个虚拟物体,Siri可以根据用户的输入进行交互。在一些例子中,头显可以生成或接收虚拟环境的视图,包括一个或多个虚拟物体。例如,如图7所示,头显可以接收视图#700,包括虚拟绘画#702和虚拟沙发#703。

在与#700视图交互时,Siri可能会收到它无法识别的语音输入#701“让沙发变成蓝色”。因此,Siri确定该命令是否与一个动作、子动作或链接模型的至少一部分元数据相匹配,以确定应该执行哪种动作。

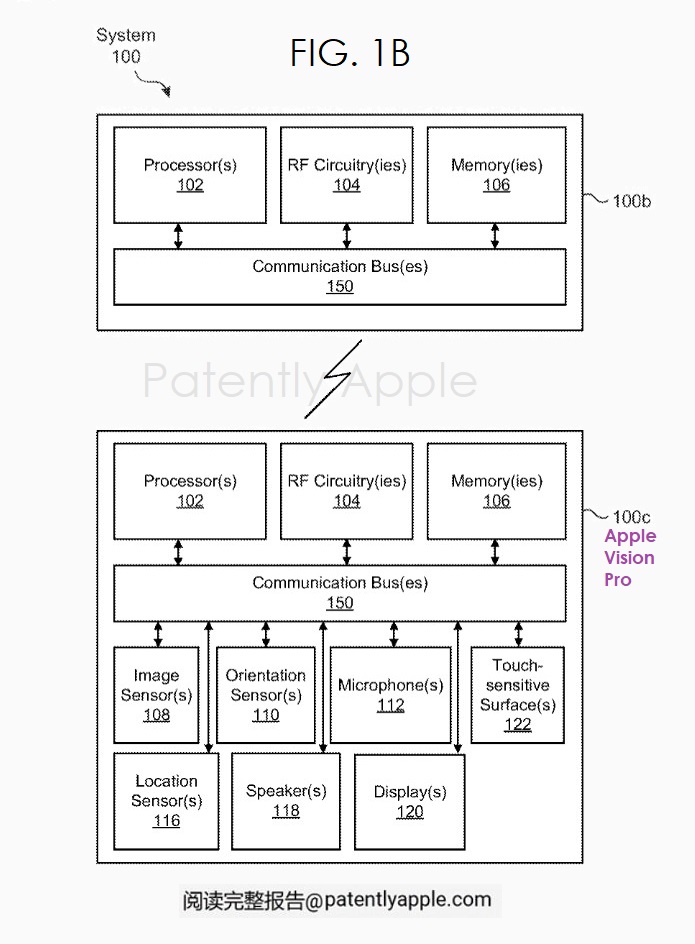

该专利还涉及Siri与其他设备(如iPhone)上的应用程序一起工作,如专利图4和6所示。这些是要映射和执行的输入命令的例子。

如上图4所示,系统可以接收语音输入#404“将单词Hey!加粗”。Siri可以处理口语输入,以确定该命令是“加粗”,但可能不理解 “加粗”命令的含义,或根据该命令执行什么动作。因此,系统和Siri可以通过访问“链接界面”来确定为命令“加粗”所要执行的行动,如下面专利图3所述。