增强现实系统中的目标注册跟踪技术

来源:第三维度

作者:王余涛 硕士学位论文

本文节选自《基于增强现实的协同式装配系统研究》第三章

增强现实(Augmented Reality)作为门新兴的技术,其研究范围包含了许多相关领域,如计算机图形学(Computer Graphics)、图像处理(ImageProcessing),机器视觉(Machine Vision)、入机交互(}{uman—ComputerInteraction)、信患可视化(Information Visual ization)、计算机网络(Computer Networks),以及图形加速设备、移动显示设备、传感器等等诸多方面。增强现实以其独特的虚实结合的技术特点拥有广泛的应用前最。本章将介绍增强现实的技术概念、发展背景、关键技术和应用情况。

1、注册跟踪

注册跟踪技术是增强现实系统的核心技术,也是目前制约增强现实技术应用的最亟待解决的技术问题。注册跟踪技术就是探寻如何能够快速直接使虚拟场景与真实世界精确对齐的方法,实现虚实场景的完美结合。将虚拟物体显示在现实世界准确位置的定位过程称为注册(Registration)。这个过程要求增强现实系统实时从当前场景中获得真实空间的数据,包括观察者的位置、头部角度、运动情况等来决定如何按照观察者的当前视场重新建立坐标系并将虚拟物体显示到正确位置,这个过程叫做跟踪(Tracking)。一般来说,增强现实系统主要采用两种跟踪方式:基于硬件设备的跟踪定位技术和基于计算机视觉的跟踪定位技术。前者主要有以下几种技术:

1)光学测量:在基准物和目标物体上安装LED灯发光,通过CCD传感器, 接收发出的光线来测量目标距离和方位。

2)GPS.主要用于户外增强现实系统,根据GPS获得用户地理位置,精度相对较低。

3)超声波:预先安装多个超声波源,通过接收装置测量观察者的位置信息。

4)磁场:安装人造磁场,通过感应线图电流强弱计算观察者的位置信息。

5)其他:利用机械装置、陀螺仪、惯性装置等设备测量观察者位置信息。基于计算机视觉的跟踪定位技术主要就是视频检测,通过图像处理和计算机视觉等技术来获取观察者位置信息,是室内增强现实系统中最为常用的跟踪定位技术,具体可分为两类:

(1) 基于标识物的方法:在真实场景中安放特殊标识物,对场景视频图片通过边缘检测,模板匹配等方法识别到标识物,然后根据已知标识物的几何信息计算虚拟空间与真实空间的坐标变换矩阵。

(2) 基于自然特征的方法:不依赖于特殊标识物,而是通过分析视频图像,获取匹配的自然特征点,经过计算推出坐标变换矩阵。

以上方法各有其优缺点,总体而言,基于硬件设备的跟踪方法一般定位速度快,实时性好,测量范围大,但需要昂贵的跟踪设备,精度不等,且跟踪过程中容易受到干扰;如磁场、超声波干扰。基于视觉的跟踪方法不需要额外的硬件设备,成本低,跟踪精度高,然后需要大量的图像处理计算,实时性差,而且测量范围小,容易受光照、雾等环境因素的影响。由于本文所研究的装配系统多处于室内有限的空间,适合采用基于计算机视觉的注册方法,也就是基于标识物或自然特征的两种方法。下面将分别介绍这两种方法。

2 基于标识物的注册跟踪方法

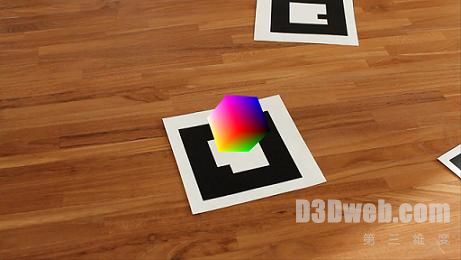

基于标识物的注册跟踪方法(Marker-based Method)是室内增强现实应用中最为常用的跟踪定位技术。由于该方法基于视频检测,不需要复杂的硬件设备,在室内小范围环境下一般可以取得符合要求的定位精度,并且达到实时性的要求。基于标识物的视频检测中通过事先定义好的各种平板标识物来标记基准位置和各个物体。系统通过模板匹配来找到视频中的对应标识物,通过图像分析处理计算虚拟空间与真实空间的坐标变换矩阵。为降低计算量,满足实时性需求,一般都采用正方形平板,上有黑色封闭矩形框和简单的标记,这样只需简单的边缘检测和模板匹配,提高识别和计算的效率。

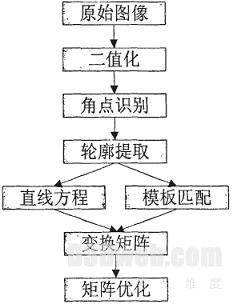

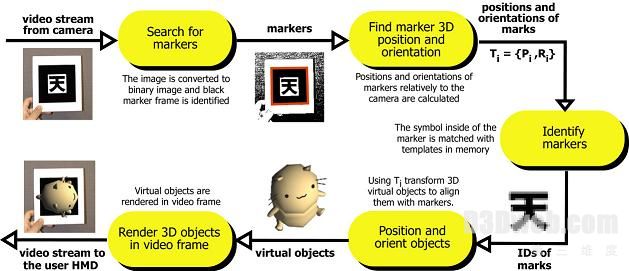

视频检测的流程就是先将视频图像二值化(binary map),再进行角点识别(corner detection)、轮廓提取(contour detection)来获得标识物边框,根据四边形边框的区域和角点坐标计算标识物边缘的直线方程。再进行模板匹配(template matching)来识别出标识物。通过摄像机内部参数和标识物轮廓信息计算标识物的变换矩阵。图1给出了基本的图像处理流程图。图2给出每个步骤的处理结果。

图1 图像处理流程图

图2 图像处理结果(为清晰起见此处图片非原文图片)

因为对于简单标识物的图像处理较为简单.所以能够快速得到注册跟踪结果,达到实时性需求。基于标识物注册的增强现实系统显示的整个流程可以归纳如下:

1)从摄像机拍摄的视频流中寻找标识物。

2)通过图像处理迭代讣算每个标识物的三维位置和方向。

3)计算世界坐标系(world coordinate system,简称WCS)与相机坐标系(camera coordi nate system,简称CCS)的变换矩阵Tcm。

4)根据标识物的字符识别对应标识,获取ID。

5)根据变换矩阵Tem,由计算机生成处于指定位置的虚拟模型。

6)绘制虚拟模型叠加到当前视频帧t,并显示到用户的监示器或头盔显示器(HMD)上。

图3基于标识物注册的增强现实系统显示流程图(ARToolKit Library)

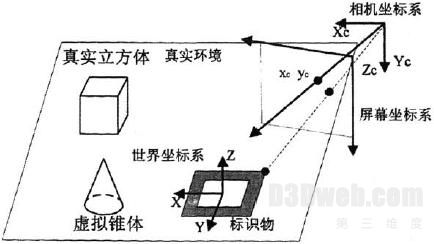

图3为ARToo]kit工具包中基于标识物注册的增强现实系统显示的流程图一其中黑色正方形的卡片即为标识物。根据标识物就可以为增强现实系统的真实环境定义一个世界坐标系(WCS),而视频图片上的坐标对应为相机坐标系(CCS)。图3 4给出了世界坐标系(WCS)与相机坐标系(CCS)的空间关系。

世界坐标系以标识物为代表,其原点为标识物的几何中心。图中虚拟的锥体由计算机生成并叠加到摄像机当前视频图片上,同真实的立方体有正确的空间位嚣关系,如同真实的一样。

图4 世界坐标系与相机坐标系的关系

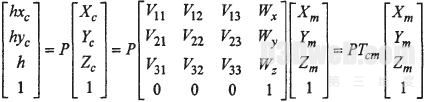

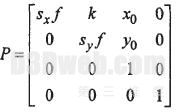

Kato et a1.(1999)探讨了如何根据标识物估计其三维位置和方向的方法。方程1给出了世界坐标系(WCS)与相机坐标系(COS)的空间关系。其中矩阵P对应相机内部参数,通过相机的初始标定过程获得;矩阵Tam为两个坐标系的转换矩阵,通过对标识物的图像处理计算而得。

(1)

(1)

(2)

(2)

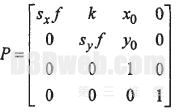

矩阵P中,f为相机焦距,sx、sy分别为x和Y方向图像像素与毫米数(pixel/mm)的放大系数,(xo,yo)为相机坐标系的Z轴穿过屏幕时的坐标。K是为了实际计算引入的X轴与y轴夹角的偏差,理论上为零,但实际计算时受噪声影响会有较小的值。矩阵Tam由X,Y,z三个方向的三个平移分量和三个旋转分量组成。获得Tcm是注册跟踪的主要目的,在图像处理后可以获得标识物在相机屏幕上的两个平行边方程,如公式3所示。

(3)

(3)

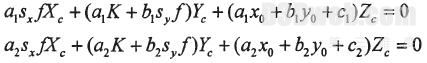

根据理想相机屏幕的投影公式,可以使用相机坐标系下的坐标代替公式3中的屏幕坐标X、Y就得到平面方程4,这两个平面方程分别包含了标识物的两条半行边。

(4)

(4)

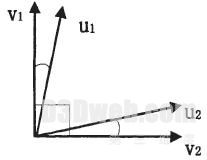

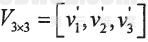

设这两个平面法向量为n1和n2,则标识物两个平行边的方向向量ul为n1xn2。同理求出另外两条平行边的方向向量u2。理论上这两个向量应该为垂直关系,但是由于相机的图像采集存在误差,u1和u2不会绝对垂直。为了补偿这个误差引入两个在u1和u2所在平面上的新向量vl和v2,其与ul、u2关系如图5所示。根据v1和v2可以求出与其垂亩的向量v3,Tcm中的旋转部分V3X3就可以由公式5求出。再将标识物四角在世界坐标系的坐标和在屏幕坐标系的坐标代入公式2.1就可求出W3×1,这样就求出最终的Tam。

图5从ul、u2计算出两个垂直向量v1、V2

(5)

(5)

以上推导方法由于图像处理的原因会存在误差,在得到Tcm后可以根据标识物坐标计算出其对应的屏幕坐标,再与实际值进行比较修正,进而得到修正后的Tcm,经过多次迭代循环后,得到较高精度的Tcm。另外由于摄像机镜头和头盔显示器可能会引入定位错误,需要对其定标(calibration),消除镜头失真造成的变形影响,可以采用网格定标发来对摄像机进行定标,具体过程参考Kato在1999年提出的增强现实会议系统中头盔和摄像机定标方法(Kato eta1.1999)。

基于标识物的注册跟踪方法由于采用特殊标识物,图像处理的计算量较小,实时性很高,并且简单实用,特别适合室内小范围的增强现实系统中,目前该方法已经广泛用于室内增强现实应用中,如华盛顿大学HitLab的Magic Book(Billinghurst et a1.2001b)。

基于标识物的注册跟踪方法同样存在其不可避免的缺点(Hirokazu eta1.,1999;Barfield et a1.,2001)。其中最大的缺点是当标识物没有出现在当前视场中或被其他物体部分遮挡时,系统注册可能就会失败。另外给予标识物注册的增强现实系统受光照的环境因素的影响较大,当处于强光下,视频中的标识物就很难被准确识别出来,也就无法完成注册。另外由于需要在真实环境中加入特殊标识物来注册坐标系,这相当于在自然的环境中加入不必要的突兀的物体。鉴于以上问题,许多学者开始研究不基于特殊标识物而是根据场景图像的自然特征来进行注册跟踪的方法。

3、基于自然特征的注册跟踪方法

简单来说,基于自然特征(natural feature)的注册跟踪方法就是根据实际场景的视频图像寻找特征点,进而计算虚实坐标系变换关系的计算方法。现实场景中的物体角点大致分为两种:低曲率点和高曲率点。低啦率点一般数量较多,信息相似,不容易检测。离曲率点,也就是自然特征点比较明显,可以通过简单的角点检测(corner detection)方法来计算,如采用Harris andStephens(1988)提出的方法。

目前许多学者提出了针对自然特征的注册跟踪方法。其中是一种经典的算法Tomasi and Kanade(1991)在卡内基梅隆大学的技术报告中提出的KLT特征跟踪法(Kanade—Lucas—Tomasi Feature Tracker)。它是一个完全基予变换模型的计算特征匹配的方法。Shi and Tomasi(1994)又利用仿射变换模型改进了KLT跟踪法。Prince et a1.(2002)提出了一个根据场景平萄结构单应变换的栩机跟踪方法。新加坡圜立大学的Yuan et al。(2005)提出了一个基于透视投影重建原理的方法来完成注册,系统只需通过两幅匹配的控制图片(control images)来检测四个初始控翻点,用以表{芷世界坐标系。这些点将作为系统参考点,系统将实时根据上一帧计算结果和当前的特征点信息更新当前的投影矩阵,进两实现实时注册跟踪。这种方法基于投影重建,不需要复杂的矩阵计算,有较快的计算速度和较好的鲁棒性。

还有一些学者利用仿射变换理论解决注册问题,根据Koenderink andUllman(1991)给出的结论,如果已知至少四个非共面的三维点,对任何投影变换,其空闻每个点的变换结果都可以由这四个点的线性组合来表示。将该理论弓|入到增强现实系统中,Kutulakos and Vallino(1998)提出了一个不采鞠相机标定丽是根据钫射变换的注册方法。Ho et a1.(2007)进一步研究了基于立体图像数据的仿射变换算法。

一般而言,基于自然特征的注船跟踪方法由于不需要引入标识物或跟踪器,是一砷完全自然地注册方式,适合于室夕}大范阐场景中,尤其在场景不适合添加标识物的情况下。另外由于场景特征点数量一般较多,不容易出现部分遮挡后无法完成注勰的情况。目前基子移动手持设备的增强现实系统多采用这种自然特征检测方法。

基于自然特征的检测方法同样存在不足之处,就是系统对视频图像全部检测计算特征点,这使得特征点检测所耗时间很大,另外对成对立体图像的特征点匹配过程较为耗时,难以达到实时性的要求。当场景检测到过多的特征点时将增加注册过程的迭代次数和总计算量。当特征点检测或匹配过程出现错误时将直接导致注册失败。

通过对基于标识物和自然特征两种注册方法的介绍可知,基于标识物的方法适合于室内小范围,易于预先安置标识物,对实时性要求较高的增强现实系统中,而基于自然特征的方法适予大范围,不易安置标识物的复杂场景中。考虑本文所研究的装配系统,其装配环境一股是室内有限的环境,而非室外大范围环境,工作空M事先可知,也就是说世界坐标系可以预先定义好。装配系统由于要实时处理大量模型的装配操作和用户交互处理,因而对系统实时要求较高,需要系统有较为快速的注册方法。鉴于以上需求,本文原型系统采用基于标识物的注册方法.其具体计算过程参见3 1。图3 6给出了本文原型系统中一个注册实例。图中左下角的标识物用来注册世界坐标系,真实的白色零件与绿色、黄色的虚拟零件有『F确的空间位置关系,表明系统注册成功。另外显示帧频太于25帧/秒,满足实时性要求。

图6基于标识物注册的实例

4、本章小结

本章介绍了增强现实系统最为核心的注册跟踪技术.着重介绍了基于标识物和基于自然特征的注册方法,并对两种方法的适用范围、优缺点等进行对比。考虑装配系统室内小范围空间的特点和对系统对实时性的要求,本文系统采用了注册速度较快的基于标识物的方法,井给出详细的计算过程,通过实例验证了该方法的有效性,为后续模块的实现提供基础。